IA (Intelligence Artificielle)

L’IA est un terme générique qui regroupe toutes les technologies et systèmes capables d’analyser des données de manière autonome, de reconnaître des motifs, de faire des prédictions et de prendre des décisions — des tâches qui, auparavant, nécessitaient un jugement humain. Grâce aux techniques dites de machine learning (apprentissage automatique) et de deep learning (apprentissage profond), les ordinateurs apprennent à partir de grandes quantités de données, ce qui leur permet de s’adapter et de s’améliorer en continu, sans que chaque étape doive être programmée manuellement.

Avec le machine learning, les ordinateurs apprennent à partir de données grâce à des exemples préalablement étiquetés et à des indications humaines, par exemple pour la détection du spam dans les e-mails.

Avec le deep learning, les ordinateurs apprennent eux-mêmes à reconnaître les motifs et caractéristiques pertinents dans de vastes ensembles de données, sans qu’un humain ait besoin de définir ces caractéristiques à l’avance — pensez à la reconnaissance faciale ou à la reconnaissance vocale avec des réseaux neuronaux.

D’où vient l’IA ?

Le terme Intelligence Artificielle (« kunstmatige intelligentie ») a été introduit en 1956 lors d’une conférence de recherche à Dartmouth (États-Unis). John McCarthy y a proposé de « rendre les machines intelligentes » en leur apprenant à raisonner comme les humains. On raconte que les chercheurs pensaient accomplir d’énormes progrès en un seul été. En réalité, la tâche s’est révélée bien plus complexe : les véritables avancées n’ont eu lieu que plusieurs décennies plus tard, lorsque des volumes suffisants de données, de puissance de calcul et d’algorithmes avancés sont devenus disponibles.

- 1980–1990 : première percée avec les systèmes experts et l’essor de techniques de machine learning plus accessibles.

- 2000–2010 : l’internet et la numérisation ont généré d’immenses quantités de données, mais la puissance de calcul restait encore limitée.

- Après 2010 : véritable accélération avec le deep learning et les GPU puissants, permettant des applications pratiques comme la reconnaissance d’images et de la parole.

- À partir de 2020 : percées avec les large language models (grands modèles de langage tels que GPT-3, GPT-4) et l’IA générative, devenues accessibles à un large public.

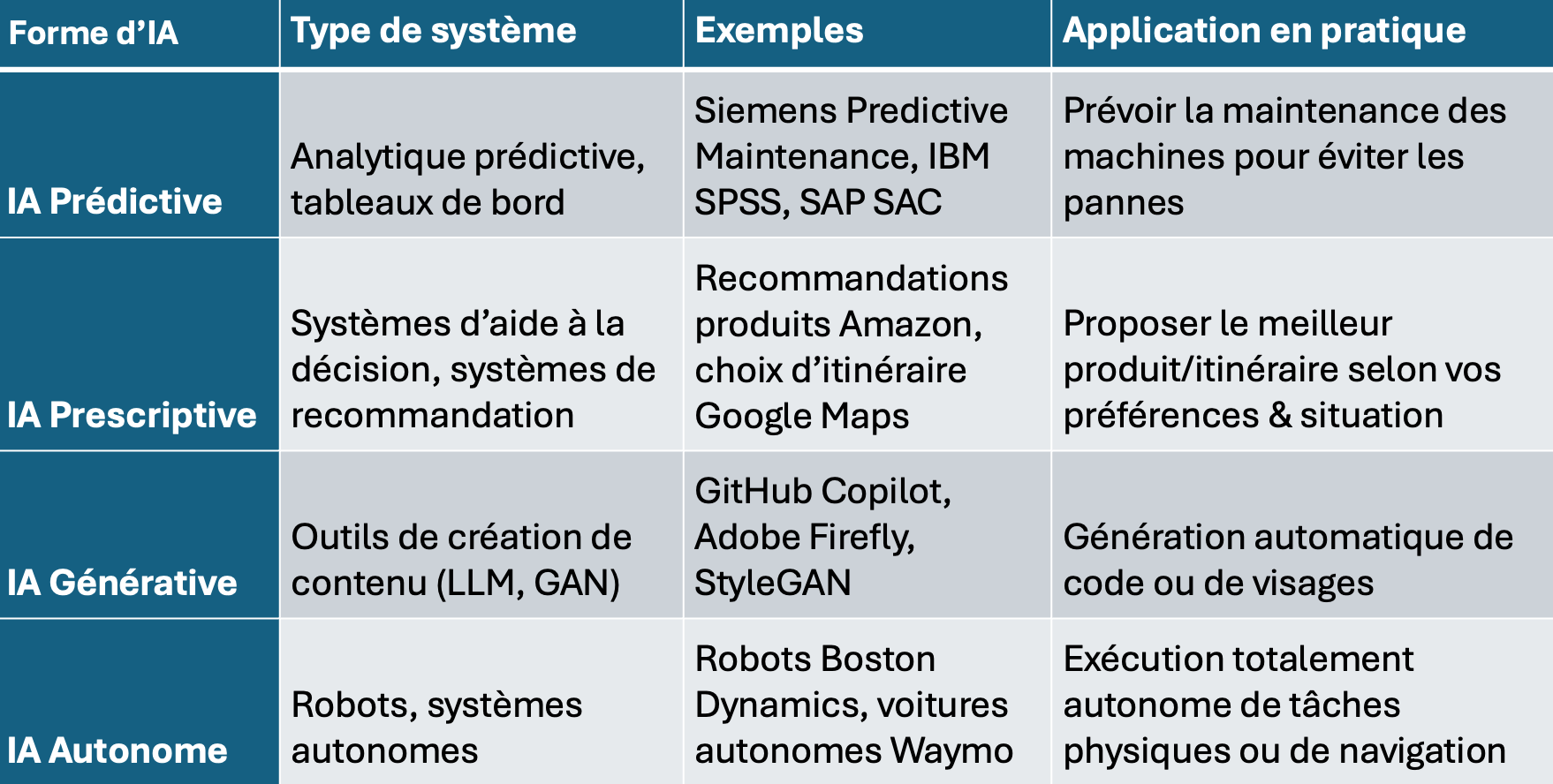

Formes d’IA

L’IA se manifeste sous différentes formes, selon l’objectif pour lequel elle est utilisée. Certaines applications sont prédictives, d’autres sont de nature consultative ou créative, et d’autres encore prennent des décisions de manière totalement autonome.

Exemples d’IA dans la pratique

- L’algorithme de recommandation de Netflix : il apprend en continu des habitudes de visionnage de millions d’utilisateurs et s’adapte sans cesse, de sorte qu’au fil du temps il peut proposer des suggestions de plus en plus pertinentes et personnalisées — sans que chaque recommandation doive être programmée manuellement.

- L’IA dans les voitures autonomes : ces véhicules analysent en continu les données des capteurs et des caméras, reconnaissent des motifs dans le trafic, prédisent les actions des autres usagers de la route et prennent des décisions de manière indépendante — comme freiner, tourner ou changer de voie — sans intervention humaine directe.

L’IA dans les médias : opportunités et défis

L’IA joue désormais un rôle majeur dans le secteur des médias. Elle est utilisée pour une création de contenu plus efficace et une expérience médiatique plus personnalisée. En même temps, cette évolution soulève des enjeux liés à la transparence, à l’éthique et à la confiance, à mesure que l’IA prend de plus en plus de tâches éditoriales en charge. Le défi pour tous les acteurs du secteur : continuer à innover, sans perdre de vue la dimension humaine.